IA agentique : du battage médiatique à l’impact réel – Ce que les entreprises suisses doivent savoir ?

L’IA agentique – des agents IA autonomes et axés sur des objectifs – apparaît comme la prochaine étape de l’intelligence artificielle, promettant de transformer le fonctionnement des organisations. Au-delà des mots à la mode, cette technologie pourrait automatiser des tâches complexes dans tous les secteurs, de l’accélération de la recherche pharmaceutique à l’amélioration des prévisions financières. Pour les entreprises suisses et autres à travers le monde, l’IA agentielle offre un immense potentiel dans des domaines tels que les opérations informatiques, la cybersécurité et l’automatisation des flux de travail, mais elle pose également de nouveaux défis en matière de gouvernance et d’intégration. Cet article explique ce qu’est l’IA agentielle, en quoi elle diffère de l’automatisation traditionnelle, les niveaux d’autonomie qu’elle implique, ses applications concrètes dans des secteurs clés et comment les entreprises peuvent se préparer à son adoption.

Qu’est-ce que l’IA agentique ?

L’IA agentique désigne les systèmes d’IA, souvent appelés agents IA, qui peuvent agir de manière autonome pour atteindre des objectifs, avec une intervention humaine minimale. En substance, une IA agentique ne se contente pas de générer du contenu ou de suivre des scripts fixes ; elle perçoit son environnement, planifie une série d’actions, exécute des tâches et apprend des résultats pour s’améliorer au fil du temps. Cette capacité d’action (d’où le terme « agentique ») est ce qui la distingue des IA précédentes :

- Automatisation traditionnelle (RPA) : des scripts ou des logiciels basés sur des règles exécutent des tâches répétitives selon une logique prédéterminée et nécessitent des instructions explicites pour chaque étape. Ils automatisent les tâches, mais ne s’adaptent pas à la volée : ils ne font que ce pour quoi ils ont été programmés.

- IA générative : les modèles tels que les grands modèles linguistiques (par exemple GPT-4) produisent du contenu (texte, images, code) en réponse à des invites, mais ils ne sont pas orientés vers un objectif : ils n’agissent pas eux-mêmes sur ce contenu. Une IA générative peut rédiger un brouillon d’e-mail ou suggérer du code, mais un humain doit encore décider quoi faire de ce résultat.

L’IA agentique va encore plus loin en combinant l’adaptabilité des modèles d’IA avancés avec la capacité d’agir. Comme l’explique IBM, les systèmes d’IA agentique utilisent des agents IA qui imitent la prise de décision humaine pour résoudre des problèmes en temps réel. Contrairement à un programme statique, une IA agentique fait preuve d’autonomie, d’un comportement axé sur les objectifs et d’adaptabilité : elle peut ajuster son approche en fonction des données en temps réel et des changements de situation. Par exemple, un assistant IA génératif pourrait recommander le meilleur moment pour escalader le Mont Blanc, mais une IA agentique pourrait aller plus loin : elle pourrait automatiquement réserver vos vols et votre hôtel pour le voyage une fois que vous aurez donné votre accord, en interagissant avec les sites web de voyage en votre nom.

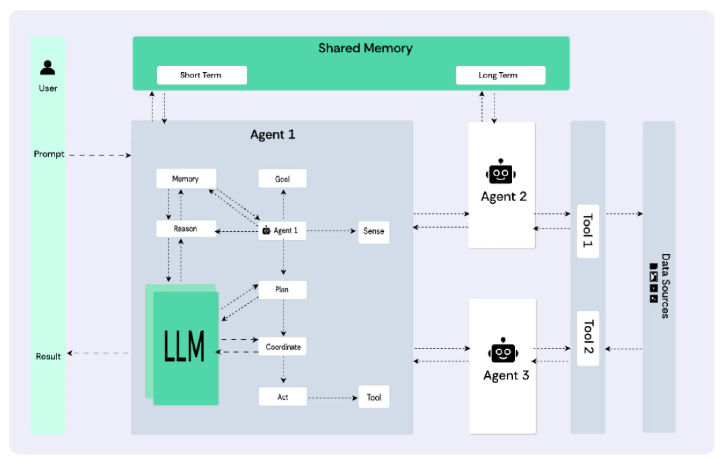

En bref, l’IA agentique = l’IA qui « agit ». Elle perçoit le contexte, prend des décisions et peut lancer de manière autonome des actions en plusieurs étapes pour atteindre un objectif, plutôt que d’attendre une intervention humaine à chaque étape. Cela est rendu possible par de nouvelles architectures d’IA, parfois appelées « grands modèles de raisonnement » (LRM) – des modèles d’IA avancés qui vont au-delà de la reconnaissance de formes pour prendre en charge un raisonnement et une prise de décision complexes. Ces LRM s’appuient sur de grands modèles linguistiques, mais ajoutent la capacité de planifier et d’orchestrer des tâches, et pas seulement de répondre à des questions. Par exemple, des recherches récentes montrent que les grands modèles de raisonnement formés par apprentissage par renforcement peuvent mener à bien de longs processus de raisonnement par étapes pour résoudre des problèmes. Dans la pratique, ces modèles fournissent à l’IA agentique son « cerveau » pour planifier des séquences d’actions et gérer les résultats inattendus au cours de ces séquences.

En quoi l’IA agentique diffère-t-elle de l’IA antérieure ?

- Comparaison avec la RPA : l’automatisation robotique traditionnelle des processus s’apparente à un robot de chaîne de montage : très efficace pour une tâche fixe, mais qui tombe en panne ou s’arrête si les conditions changent ou si un événement nouveau survient. L’IA agentique s’apparente davantage à un robot intelligent capable de s’adapter à la volée : elle dispose de la flexibilité nécessaire pour modifier son plan en fonction de nouvelles données. En effet, alors que la RPA repose sur des règles prédéterminées, une IA agentique adapte son comportement en fonction des données saisies et des objectifs fixés. Cela signifie qu’elle peut gérer la variabilité et les exceptions beaucoup mieux qu’une automatisation rigide.

- Comparaison avec l’IA générative : l’IA générative est puissante pour créer des résultats (un rapport, une image, un morceau de code) à partir d’entrées données, mais elle ne prendra pas d’initiative au-delà de cela. L’IA agentique utilise l’IA générative comme un simple composant : elle exploite les résultats génératifs, puis passe à l’action. Considérez l’IA générative comme un assistant talentueux qui fournit des informations ou des ébauches, tandis que l’IA agentique s’apparente davantage à un chef de projet capable d’utiliser ces ébauches pour mener à bien des tâches. Les experts en IA d’Oracle la décrivent ainsi : une IA de base est comme un technicien qualifié qui effectue une seule tâche lorsqu’on le lui demande, tandis que l’IA agentique agit davantage comme un gestionnaire, décidant quels outils ou « techniciens » (y compris les modèles génératifs) déployer et dans quel ordre pour atteindre un objectif. Le système agentique choisit de manière autonome comment atteindre l’objectif, plutôt que de se contenter de produire un résultat et de s’arrêter là.

En termes pratiques, l’IA agentique peut impliquer un système multi-agents, c’est-à-dire plusieurs agents IA spécialisés qui travaillent ensemble et communiquent entre eux. Un agent peut se charger de la perception (collecte de données), un autre de la planification, d’autres encore de l’exécution de diverses sous-tâches. Ils se coordonnent via une couche d’orchestration IA. C’est pourquoi l’IA agentielle est souvent évoquée en parallèle de la collaboration multi-agents : des équipes d’agents IA se répartissent des processus complexes. L’objectif est de créer une IA capable de « voir, penser et agir » : percevoir l’environnement, raisonner sur ce qui doit être fait, puis prendre les mesures appropriées, de manière continue et autonome.

Niveaux d’autonomie dans l’IA agentique

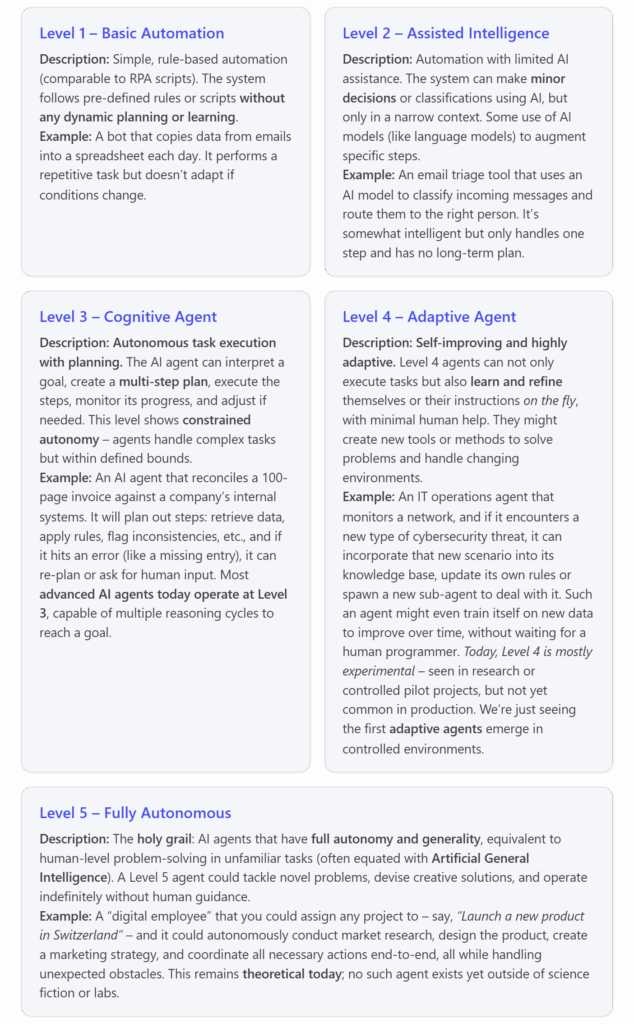

Tous les agents IA ne sont pas créés égaux : il existe tout un spectre d’autonomie. Les experts du secteur décrivent souvent les capacités des agents IA en « niveaux » (à l’instar de l’autonomie des voitures autonomes, qui va du niveau 0 au niveau 5). Comprendre ces niveaux permet de faire la part des choses et de clarifier ce que les agents IA actuels peuvent et ne peuvent pas faire. La plupart des systèmes d’agents actuels sont de niveau intermédiaire (environ niveau 3) : ils disposent d’une certaine autonomie, mais restent soumis à des contraintes. Les agents entièrement autonomes de niveau 5 restent hypothétiques. Vous trouverez ci-dessous un résumé des niveaux d’autonomie des agents IA couramment cités, leurs caractéristiques et des exemples :

*** Traduit avec www.DeepL.com/Translator (version gratuite) ***

(Les niveaux ci-dessus constituent un cadre général – différentes organisations les définissent de manière légèrement différente. Certaines commencent à compter à partir du niveau 0 pour l’absence d’autonomie. Mais l’essentiel réside dans la progression depuis les simples robots scriptés vers une IA véritablement autonome.)

Où en sommes-nous aujourd’hui ? Principalement au niveau 3. L’IA agentielle de pointe actuelle (fin 2025) permet l’exécution autonome de tâches en plusieurs étapes selon des objectifs fixés par l’homme. Par exemple, de nombreux « agents IA » de processus métier peuvent prendre en charge la demande d’un utilisateur, puis gérer une séquence de sous-tâches dans différentes applications pour y répondre. Parallèlement, les capacités de niveau 4 se profilent à l’horizon. Les premiers exemples d’agents adaptatifs et auto-améliorants sont actuellement testés dans des niches (souvent avec des humains dans la boucle pour s’assurer que tout se passe bien). Le niveau 5 reste ambitieux : il fait l’objet de recherches et de nombreux débats quant à savoir s’il sera atteint et quand.

De l’engouement à l’impact : applications concrètes de l’IA agentique

Malgré l’engouement suscité par cette technologie, il est important de se poser la question suivante : que fait réellement l’IA agentique dans le monde réel aujourd’hui ? Si de nombreux projets en sont encore au stade de la validation de principe, nous constatons déjà des impacts tangibles dans divers secteurs. Voici quelques domaines clés et exemples où l’IA agentique dépasse le stade du battage médiatique pour entrer dans la pratique :

- Recherche pharmaceutique : dans le domaine pharmaceutique, une tâche fastidieuse mais cruciale consiste à passer en revue des montagnes de publications scientifiques lors de la découverte de médicaments. Les agents IA contribuent désormais à automatiser ces revues de littérature, accélérant considérablement la recherche. Par exemple, NVIDIA a récemment présenté un « agent de recherche » biomédical capable d’ingérer et d’analyser des centaines d’articles scientifiques en quelques minutes, ce qui prendrait des semaines à des chercheurs humains. Cet agent résume non seulement les résultats, mais peut même proposer des hypothèses scientifiques en raisonnant à partir des données. Il agit essentiellement comme un analyste de recherche junior qui lit des revues sans interruption. Les entreprises pharmaceutiques utilisent ces outils pour accélérer la R&D en amont, en identifiant beaucoup plus rapidement qu’auparavant les cibles thérapeutiques ou les études pertinentes. Cela pourrait permettre d’accélérer la découverte de nouveaux traitements, les agents prenant en charge une partie de la charge de travail liée à la recherche.

- Prévisions financières et économiques : les équipes financières et les économistes expérimentent des systèmes multi-agents afin d’améliorer les prévisions et la prise de décision. L’idée est que si vous disposez de plusieurs agents autonomes, chacun peut adopter une perspective ou un ensemble de données différent, un peu comme une équipe d’analystes débattant de différents scénarios. Par exemple, un agent peut simuler des conditions de marché optimistes, tandis qu’un autre suppose un scénario pessimiste ; un troisième agent peut se concentrer sur les facteurs de risque géopolitiques. Ces agents peuvent ensuite comparer leurs notes ou « débattre », afin de dégager une perspective plus nuancée, par exemple pour les prévisions économiques du trimestre suivant. Les premières expériences montrent que le recours à un « débat » ou à un ensemble d’agents IA peut donner des résultats plus précis qu’un modèle unique. Certains fonds spéculatifs et banques ont commencé à tester des approches multi-agents pour soumettre leurs modèles financiers à des tests de résistance dans divers scénarios hypothétiques. L’objectif est d’améliorer la prévision, en identifiant les risques et les opportunités potentiels en laissant les agents IA effectuer de nombreuses simulations en parallèle, beaucoup plus rapidement que n’importe quelle équipe humaine. (En fait, une récente enquête de Gartner a révélé que 57 % des équipes financières mettent déjà en œuvre ou prévoient de mettre en œuvre l’IA agentielle dans leurs flux de travail, dans le but d’obtenir des avantages dans des domaines tels que la détection des anomalies en temps réel et le rapprochement automatisé.)

- Commerce de détail et chaîne d’approvisionnement : les détaillants testent actuellement l’IA agentique pour répondre en temps réel aux données provenant des magasins et des chaînes d’approvisionnement. Imaginez un agent IA qui surveille les niveaux de stock, les tendances des ventes et même le buzz sur les réseaux sociaux minute par minute. Si un produit particulier se vend moins bien que prévu et que les stocks s’accumulent, l’agent pourrait lancer de manière autonome une promotion en temps réel ou une remise sur le prix de ce produit sur le site de commerce électronique du détaillant afin de stimuler les ventes. À l’inverse, si un article se vend comme des petits pains (ou si les commandes en ligne augmentent soudainement), l’agent pourrait automatiquement commander à nouveau des stocks ou même ajuster le marketing pour se concentrer sur ce best-seller. En substance, ces agents visent à optimiser les « promotions basées sur les stocks » et à approvisionner les commandes à la volée. Un exemple plus simple est le réapprovisionnement : un système agentique peut détecter les conditions actuelles et commander des fournitures ou des produits plus efficacement et plus rapidement que des humains surveillant des tableaux de bord. Plusieurs grands détaillants et plateformes de commerce électronique testent actuellement ces boucles de décision basées sur l’IA afin de minimiser les ruptures de stock et les démarques. Pour les entreprises de vente au détail suisses réputées pour l’efficacité de leur logistique, ce type d’automatisation pourrait rationaliser davantage les opérations en garantissant que les bons produits se trouvent au bon endroit au bon moment, avec un minimum d’intervention manuelle.

- Automobile et fabrication : les voitures modernes nécessitent des millions de lignes de code et font l’objet de mises à jour fréquentes. Les constructeurs automobiles se tournent vers l’IA agentielle pour accélérer le développement et les tests des logiciels destinés aux véhicules. Dans un exemple concret, une entreprise a mis en place un pipeline de développement logiciel « agentiel » : un agent d’architecture spécialisé a pris en charge les spécifications de conception d’une nouvelle fonctionnalité et a généré en une nuit une ébauche de conception logicielle ; ensuite, un agent de test a créé automatiquement une suite de cas de test. Le lendemain matin, les ingénieurs humains avaient une longueur d’avance : la conception de base et les tests étaient prêts à être examinés. Ce type d’effort parallèle de « l’équipe IA » peut réduire considérablement le temps de développement, ce qui est essentiel dans les cycles d’innovation automobile. Plusieurs agents IA travaillant de concert (l’un s’assurant que le code respecte les normes de sécurité, l’autre simulant en permanence des scénarios de conduite pour tester le nouveau code) peuvent accélérer considérablement le développement et la validation des nouvelles fonctionnalités logicielles des voitures. Bien que les constructeurs automobiles n’en soient encore qu’à leurs débuts dans ce domaine, cela illustre bien comment l’IA agentielle peut orchestrer des flux de travail complexes et collaboratifs (très pertinents pour toute industrie fortement axée sur l’ingénierie). Au-delà du développement, les opérations de fabrication elles-mêmes peuvent utiliser des agents pour la planification adaptative, la maintenance prédictive (agents qui surveillent les données des machines et ajustent les plans de production), et même la robotique collaborative sur les chaînes de montage.

Pourquoi est-ce important pour les entreprises suisses ? La Suisse, avec son secteur pharmaceutique robuste, ses institutions financières et son industrie manufacturière de pointe (notamment dans les domaines de l’ingénierie de précision et de l’horlogerie), devrait tirer un grand profit de ces applications d’IA agentielle :

- Les entreprises pharmaceutiques suisses peuvent tirer parti des agents de recherche IA pour conserver leur avance dans la découverte de médicaments et l’innovation médicale.

- Les banques et les assureurs de Zurich ou Genève peuvent utiliser des analystes IA autonomes pour améliorer la modélisation des risques et la conformité réglementaire (le secteur financier suisse étant très réglementé, une IA agentielle capable de surveiller les transactions et de signaler les problèmes de manière autonome et en temps réel pourrait changer la donne en matière de conformité et de lutte contre la fraude).

- Les entreprises suisses du secteur de la vente au détail et de la chaîne d’approvisionnement (comme les produits de luxe ou les produits chimiques) peuvent adopter des agents IA pour optimiser leurs stocks et leur logistique sur les marchés hautement interconnectés du pays.

- Dans le domaine des opérations informatiques et de la cybersécurité, qui concernent toutes les entreprises suisses, l’IA agentique peut automatiser la surveillance de routine. Par exemple, il devient possible de mettre en place des agents de cybersécurité qui surveillent le trafic réseau 24 heures sur 24, 7 jours sur 7, détectent les anomalies et isolent même automatiquement les violations. Cela est particulièrement pertinent en Suisse, où la confidentialité et la sécurité des données sont primordiales ; le fait de disposer d’agents IA qui réagissent instantanément aux menaces (et apprennent de chaque tentative) peut renforcer les défenses.

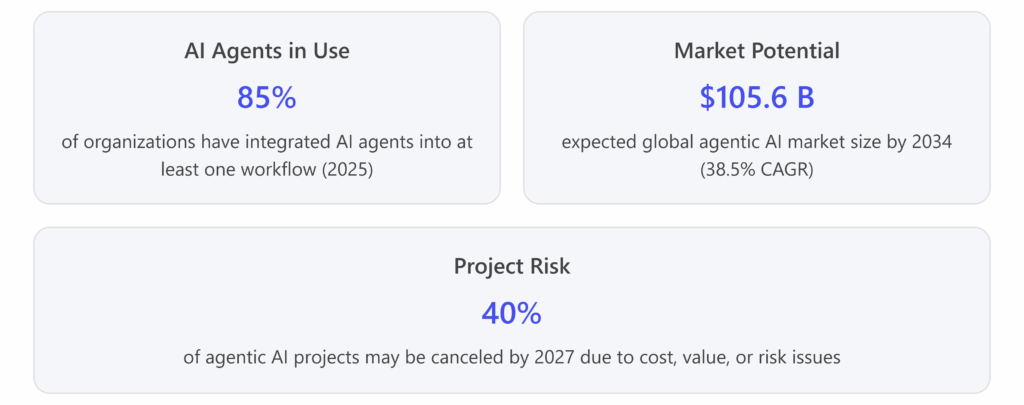

Attention : ne vous laissez pas aveugler par le battage médiatique. Il convient de noter que, même si ces exemples sont prometteurs, l’IA agentielle est encore un domaine naissant. De nombreux produits « agents » disponibles sur le marché ne sont pas encore vraiment autonomes : certains fournisseurs rebaptisent d’anciens outils (RPA ou simples chatbots) « agents IA » sans qu’ils aient de réelles capacités agentiales. Les analystes de Gartner ont qualifié cette tendance d’« agent washing ». Comme l’explique Anushree Verma, directrice senior chez Gartner : « La plupart des projets d’IA agentique actuels sont des expériences préliminaires ou des preuves de concept qui sont principalement motivées par le battage médiatique et souvent mal appliquées. » En d’autres termes, les entreprises doivent faire la part des choses entre la réalité et le marketing. La section suivante aborde les défis qui peuvent faire ou défaire les initiatives d’IA agentique. [sema4.ai]

Les défis sur la voie de l’autonomie

Adopter l’IA agentique ne se fait pas en un clin d’œil. Les organisations sont confrontées à des défis et des risques importants lorsqu’elles passent de la phase pilote à la phase de production. Il est essentiel pour toute entreprise, suisse ou autre, qui souhaite tirer parti des agents IA autonomes de comprendre ces écueils. Les principaux défis sont les suivants :

- Gouvernance et sécurité : De par leur nature, les systèmes d’IA agentielle agissent au nom des humains au sein de nos applications et réseaux. Cela soulève une question importante : comment contrôler et faire confiance à quelque chose qui est conçu pour prendre ses propres décisions ? La gouvernance consiste à fixer des limites (ce qu’un agent IA est autorisé à faire ou à ne pas faire) et à assumer la responsabilité lorsque des agents autonomes commettent des erreurs. Par exemple, si un agent IA a accès à des données sensibles sur les clients pour faire son travail, des contrôles de sécurité stricts et des journaux d’audit sont nécessaires pour éviter toute utilisation abusive. Il existe également le risque qu’un agent « déraille » et poursuive un objectif de manière inappropriée. Sans surveillance adéquate, un agent autonome pourrait, par exemple, essayer de supprimer ce qu’il considère comme des fichiers redondants afin de libérer de l’espace, mais supprimer accidentellement des données critiques. Il est essentiel de définir des garde-fous clairs. Les entreprises doivent établir des règles telles que : les processus qu’un agent peut gérer de manière indépendante, les cas où il doit obtenir l’approbation d’un humain et les déclencheurs permettant de l’arrêter s’il se comporte de manière inattendue. Dans la pratique, les experts recommandent une approche impliquant l’intervention humaine pour les tâches à haut risque, par exemple lorsqu’une IA signale une transaction financière suspecte, mais qu’un humain prend la décision finale. Une autre bonne pratique consiste à déployer des agents de « validation » aux côtés des agents principaux. Par exemple, un agent exécute des tâches tandis qu’un autre surveille la conformité de ces actions, créant ainsi un filet de sécurité. En conclusion, l’autonomie ne doit jamais rimer avec anarchie. Comme l’a observé un technologue, « l’anarchie résulte d’une autonomie dépourvue de gouvernance. Cependant, lorsque l’autonomie est associée à une supervision, la qualité et la vitesse commencent à évoluer ensemble ». La sécurité est tout aussi cruciale : les agents autonomes ont souvent besoin d’un accès étendu au système, les entreprises doivent donc appliquer un accès avec privilèges minimaux, une authentification rigoureuse et des mesures de protection pour empêcher qu’un agent IA ne soit détourné par des acteurs malveillants.

- Intégration et complexité : le succès de l’IA agentielle ne dépend pas uniquement de l’IA elle-même, mais aussi de l’écosystème dans lequel elle évolue. Les agents ont besoin de données, et en grande quantité, provenant de nombreuses sources. Si les données d’une entreprise sont cloisonnées ou si ses processus informatiques ne sont pas numérisés, un agent IA sera comme une voiture à remontoir coincée dans un placard : il ne pourra aller nulle part. La mise en œuvre d’une IA agentielle oblige souvent les entreprises à mettre de l’ordre dans leurs données : unifier les sources de données, améliorer la qualité des données et fournir des API ou des interfaces que l’IA peut utiliser pour interagir avec les applications. De nombreux projets initiaux ont échoué parce que les données ou le flux de travail sous-jacents n’étaient pas prêts pour l’IA. De plus, l’introduction d’agents IA peut nécessiter une refonte des processus. Il ne suffit pas d’intégrer un agent autonome dans un processus manuel désorganisé pour obtenir des résultats exceptionnels. Souvent, les entreprises doivent rationaliser ou repenser leur flux de travail afin qu’un agent IA puisse le prendre en charge de manière judicieuse. Cette intégration est complexe : l’IA doit se connecter aux logiciels existants (ce qui peut nécessiter des connecteurs personnalisés) et les employés doivent s’adapter à de nouvelles étapes de leur routine basées sur l’IA. Il y a également une question de préparation culturelle : les employés doivent faire confiance aux agents IA et collaborer efficacement avec eux. Si les employés passent constamment outre les décisions de l’agent ou remettent en question son jugement, les avantages de l’automatisation s’évaporent. Selon Gartner, les organisations disposant de processus matures et bien documentés et de données de qualité auront beaucoup plus de facilité à intégrer l’IA agentielle. Celles qui ne disposent pas de ces bases auront beaucoup plus de mal. Considérez l’IA agentielle comme l’arrivée d’un nouveau membre très intelligent dans votre équipe : si les connaissances et les outils de votre équipe sont désorganisés, même un génie aura du mal à apporter sa contribution.

- Coût et risque d’échec : comme toute technologie émergente, l’IA agentique s’accompagne de coûts d’investissement et d’incertitudes. Le développement ou le déploiement d’agents autonomes (en particulier ceux personnalisés pour une entreprise) peut être coûteux, car il nécessite des plateformes logicielles spécialisées, des ressources informatiques pour les modèles d’IA et des talents pour les créer et les maintenir. Si un projet n’est pas bien défini, les coûts peuvent rapidement augmenter sans retour sur investissement clair. De plus, le risque d’échec n’est pas négligeable. En effet, Gartner prévoit que plus de 40 % des projets d’IA agentique seront annulés ou échoueront d’ici la fin 2027. Les raisons invoquées sont révélatrices : coûts croissants, valeur commerciale incertaine ou gestion des risques inadéquate. De nombreuses organisations se lancent dans des projets pilotes d’IA en raison du battage médiatique, mais ont ensuite du mal à les développer lorsque les résultats sont décevants ou lorsque des complexités inattendues apparaissent. De plus, les erreurs commises par des agents autonomes peuvent avoir des conséquences importantes : un agent malveillant dans le domaine financier peut effectuer une transaction erronée, ou un bug dans un agent d’automatisation informatique peut provoquer une panne du système. Ces risques font que les entreprises avancent souvent lentement, ce qui peut frustrer les parties prenantes qui s’attendent à des gains rapides. La gestion des attentes (en interne et en externe) fait partie du défi. Il est judicieux de commencer par des cas d’utilisation plus modestes et à faible risque afin de prouver la valeur ajoutée avant de passer à l’échelle supérieure. Un autre facteur de coût est le talent : des experts qui comprennent à la fois l’IA et le domaine d’activité sont nécessaires pour guider ces projets (et ces talents sont très demandés et rares). Conclusion : l’IA agentielle n’est pas une solution miracle que l’on achète simplement dans le commerce. Elle nécessite une planification minutieuse et des ressources, et même dans ce cas, certains projets échoueront. Les entreprises doivent prévoir un budget pour un parcours plus long et d’éventuelles itérations, et non pour un déploiement unique.

- Préoccupations réglementaires et éthiques : pour les entreprises suisses en particulier, qui opèrent souvent dans des secteurs soumis à des réglementations strictes (finance, santé, etc.), le déploiement d’agents autonomes soulève des questions de conformité. Comment contrôler les décisions prises par un agent IA ? Si une IA formule une recommandation qui affecte un client (comme le refus d’une demande de prêt ou l’ajustement d’une prime d’assurance), la réglementation peut exiger une explication, alors que le raisonnement de l’IA peut être une boîte noire. Garantir la transparence et l’explicabilité des décisions prises par les agents IA est un domaine en plein développement. Parmi les meilleures pratiques émergentes, on peut citer l’enregistrement de chaque action effectuée par un agent et de la raison pour laquelle elle a été effectuée, afin de disposer d’une piste d’audit. Sur le plan éthique, les entreprises doivent s’assurer que les agents IA ne commettent pas de discrimination involontaire et ne produisent pas de résultats injustes, en particulier lorsqu’ils s’adaptent et apprennent. Se pose également la question de l’emploi : bien que l’IA agentielle vise à renforcer les équipes humaines et non à les remplacer, les employés peuvent s’inquiéter de l’automatisation. Une communication claire et des programmes de reconversion professionnelle peuvent atténuer les craintes et la résistance. Les entreprises suisses, réputées pour leurs normes élevées en matière de responsabilité d’entreprise, devront intégrer leur gouvernance de l’IA à leur gouvernance d’entreprise globale, en veillant à ce que les systèmes autonomes soient conformes aux normes juridiques et éthiques.

En résumé, l’adoption de l’IA agentique représente autant un défi humain et procédural qu’un défi technique. Un leadership fort est nécessaire pour gérer ces questions : il faut définir une vision, mais aussi mettre en place les contrôles appropriés afin que les agents autonomes soient bénéfiques et se comportent de manière responsable.

Normes émergentes : Agent-to-Agent (A2A) et Model Context Protocol (MCP)

Une évolution prometteuse pour aider à résoudre une partie de cette complexité est l’émergence de normes ouvertes pour les agents IA. Deux noms que vous entendrez souvent sont Agent2Agent (A2A) et Model Context Protocol (MCP). Il s’agit de nouveaux protocoles conçus pour rendre les agents IA plus interopérables et plus faciles à gérer, essentiellement pour garantir que différents agents et outils IA puissent communiquer entre eux dans un « langage » commun.

- Agent2Agent (A2A) : initialement promu par Google (avec le soutien de dizaines d’entreprises), A2A est un protocole ouvert permettant à des agents IA indépendants de communiquer directement entre eux. Considérez A2A comme un « bus de communication universel pour agents ». Si l’entreprise A crée un agent pour la planification et l’entreprise B un agent pour l’analyse de données, A2A fournirait les règles permettant à ces agents de partager des informations et de coordonner leurs tâches en toute sécurité, même s’ils ont été créés par des fournisseurs différents. Il définit la manière dont les agents annoncent leurs capacités (à l’aide d’une sorte de carte de visite numérique pour agents) et échangent des messages et des demandes de manière standardisée. Vue d’ensemble : l’A2A pourrait permettre à un riche écosystème d’agents IA (provenant de différents fabricants) de se connecter et de fonctionner immédiatement, plutôt que de devoir personnaliser chaque intégration. Cette communication horizontale d’agent à agent s’apparente à la création d’un « HTTP pour agents », une couche fondamentale pour le web agentique.

- Protocole de contexte modèle (MCP) : initiative associée à Anthropic (un autre leader dans le domaine de l’IA), le MCP répond à un besoin différent : la manière dont un agent IA interagit avec ses outils et son contexte. Le MCP vise à permettre à une IA (en particulier un modèle d’IA tel qu’un LLM) d’accéder à des ressources et des mémoires externes de manière structurée. Par exemple, un agent peut avoir besoin de récupérer les cours boursiers en temps réel, d’utiliser une base de données ou d’appeler une API. Le MCP normaliserait la manière dont l’agent représente et récupère ce contexte externe ou invoque des outils. En substance, si l’A2A concerne les agents qui communiquent entre eux de manière horizontale, le MCP concerne un agent qui se connecte verticalement à des données, des connaissances et des outils. Il pourrait par exemple définir une manière uniforme pour un agent de stocker sa mémoire à long terme ou de demander des informations supplémentaires lorsqu’il n’est pas sûr de quelque chose. [clarifai.com]

Pourquoi ces normes sont-elles importantes ? Parce qu’à mesure que l’adoption de l’IA agentielle se développe, les entreprises pourraient se retrouver avec une multitude d’agents qui ne fonctionnent pas facilement ensemble : l’agent IA d’une équipe pourrait ne pas comprendre celui d’une autre. L’A2A et le MCP visent à éviter un scénario de tour de Babel en fournissant des cadres communs. Ils sont encore en cours de maturation, mais des dizaines d’entreprises technologiques les soutiennent. Les premiers utilisateurs expérimentent ces protocoles afin de créer des systèmes multi-agents qui ne sont pas tous verrouillés dans l’écosystème d’un seul fournisseur. Pour les entreprises, cela pourrait se traduire par une plus grande flexibilité (vous pourriez intégrer des agents provenant de différentes sources) et une meilleure gouvernance (les protocoles standard peuvent inclure des mesures de sécurité et d’audit dès leur conception). Par exemple, A2A impose l’authentification et les autorisations lorsque les agents interagissent, ce qui peut réduire les incohérences en matière de sécurité qui surviennent lorsque tout le monde crée des intégrations personnalisées.

Il convient de noter que ces normes ne sont pas des solutions miracles : elles évolueront et leur adoption par l’industrie prendra du temps. Mais elles indiquent une orientation importante : la communauté de l’IA agentielle réalise que pour passer de démonstrations impressionnantes à une réalité opérationnelle, nous avons besoin de l’équivalent de normes de communication et de garde-fous. Tout comme les API et les normes web ont permis à différents systèmes logiciels de fonctionner ensemble, l’A2A et le MCP pourraient faciliter la mise en place de systèmes multi-agents complexes. Un expert de Gartner a fait remarquer que ces protocoles pourraient devenir le « HTTP des agents », une couche fondamentale permettant la prochaine génération de flux de travail basés sur l’IA.

Pour un chef d’entreprise suisse, les détails techniques de l’A2A ou du MCP ne sont pas aussi importants que le fait que l’écosystème se concentre sur l’interopérabilité et la sécurité. Lors de l’évaluation des solutions d’IA, il est judicieux de demander aux fournisseurs comment ils mettent en œuvre la communication entre agents et la gestion du contexte. La conformité aux normes émergentes peut être un signe que le produit s’intégrera plus facilement dans une stratégie d’IA plus large et n’isolera pas votre entreprise avec un agent propriétaire qui ne peut pas fonctionner avec d’autres.

Se préparer à l’adoption : comment les entreprises peuvent adopter l’IA agentique

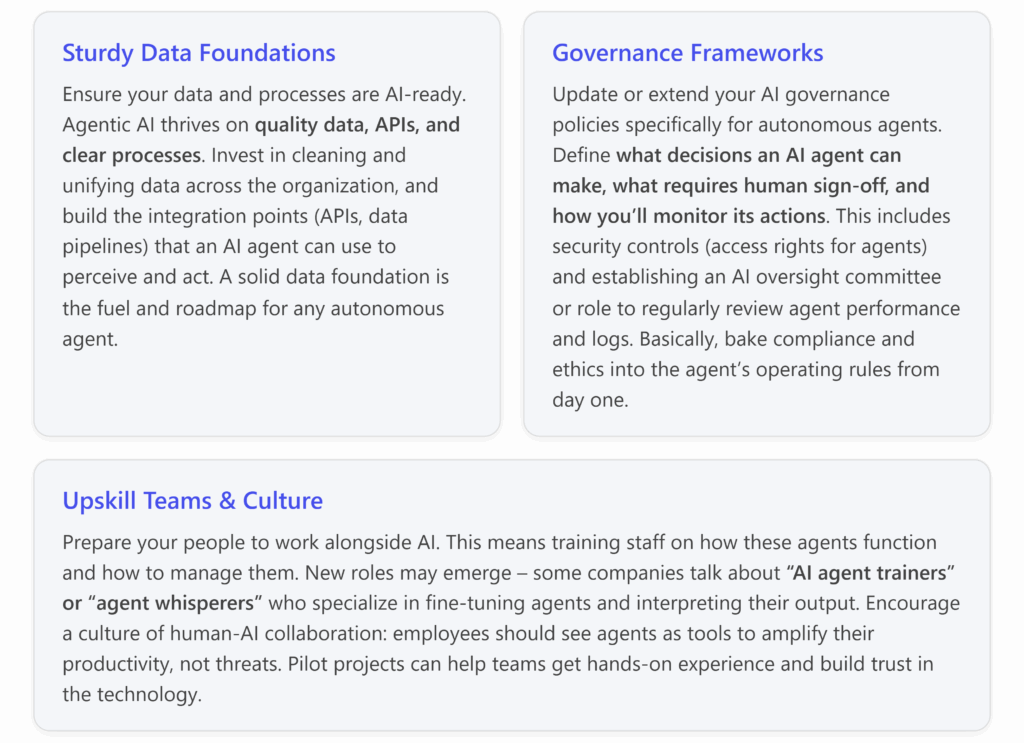

Compte tenu des opportunités et des défis, que devraient faire les entreprises aujourd’hui pour se préparer à l’IA agentielle ? Que vous soyez directeur informatique d’une banque suisse ou directeur technique d’une entreprise manufacturière, quelques mesures préparatoires clés peuvent vous mettre sur la voie du succès :

En plus des piliers ci-dessus, les entreprises doivent commencer modestement et de manière ciblée. Identifiez quelques cas d’utilisation où l’IA agentielle pourrait résoudre un problème évident, idéalement des tâches qui prennent beaucoup de temps au personnel mais qui suivent des étapes et des règles logiques (par exemple, l’automatisation des demandes d’assistance informatique de niveau 1 ou le traitement hebdomadaire des données courantes). En menant un projet pilote dans un domaine restreint, vous pouvez découvrir ce qui fonctionne et ce qui ne fonctionne pas dans un environnement à faible risque. Mesurez les résultats : cela a-t-il permis de gagner du temps, de réduire les erreurs, d’améliorer la rapidité ? Utilisez ces indicateurs pour justifier une extension ou un ajustement de la stratégie.

Une autre mesure pratique consiste à auditer votre chaîne d’outils actuelle : de nombreuses plateformes logicielles (des systèmes CRM aux outils de gestion des services informatiques) intègrent désormais des fonctionnalités d’automatisation basées sur l’IA. Vérifiez si les outils dont vous disposez déjà possèdent des capacités agentives que vous pouvez activer ou tester. Par exemple, Microsoft et d’autres grands fournisseurs intègrent des agents autonomes (parfois appelés « copilotes ») dans leurs produits d’entreprise. Ceux-ci peuvent servir de point d’entrée pour essayer l’IA agentive à l’aide de logiciels familiers.

Collaborez également avec des experts et des pairs. Ce domaine évolue si rapidement que rester informé représente la moitié du chemin. Les entreprises suisses peuvent tirer parti des centres de recherche locaux spécialisés dans l’IA (ETH Zurich, EPFL Lausanne, etc.) ou des groupes industriels pour se tenir informées des meilleures pratiques. Participer à des conférences ou à des webinaires sur l’IA agentique (il en existe de nombreux à l’échelle mondiale, car tout le monde cherche à comprendre ce domaine) peut permettre d’obtenir des informations et des enseignements tirés par les premiers utilisateurs.

Enfin, planifiez à long terme. L’IA agentique n’est pas seulement une mode passagère, elle s’inscrit dans une vague plus large d’IA qui passe de l’assistance aux humains à l’action en leur nom. Elle pourrait remodeler les rôles professionnels (en créant un besoin accru de réflexion stratégique et de supervision, les tâches routinières étant automatisées) et même les modèles commerciaux (imaginez des fournisseurs d’« IA en tant que service » qui louent des agents autonomes spécialisés dans différentes tâches). Les entreprises qui commenceront tôt à intégrer ces capacités bénéficieront d’un avantage concurrentiel, tout comme celles qui ont adopté Internet dès ses débuts. Mais il est essentiel de le faire de manière réfléchie, en trouvant le juste équilibre entre innovation et responsabilité.

Conclusion : de la mode à la valeur commerciale

L’IA agentique dépasse désormais le stade du simple mot à la mode et fait progressivement son entrée dans les opérations réelles. La vision d’agents logiciels capables de gérer de manière autonome des tâches complexes, qui relevait autrefois purement de la science-fiction, est désormais suffisamment réaliste pour attirer l’attention des entreprises tournées vers l’avenir. Pour les entreprises et organisations suisses du monde entier, le message est clair : il s’agit d’une opportunité et d’un défi stratégiques. Bien utilisée, l’IA agentielle peut débloquer de nouveaux niveaux de productivité, en prenant en charge les tâches fastidieuses et en permettant aux employés de se concentrer sur des activités à plus forte valeur ajoutée. Elle peut aider les entreprises à réagir plus rapidement aux changements, qu’il s’agisse d’une évolution de la demande du marché ou d’un incident informatique soudain à 3 heures du matin, grâce à des agents IA infatigables. Elle est même susceptible de stimuler l’innovation, car les équipes tirent parti de leurs « collègues » IA pour explorer des idées et des solutions qui seraient irréalisables avec le seul effort humain.

Cependant, pour réaliser cette valeur, il faut aller au-delà du battage médiatique. Les entreprises doivent aborder l’IA agentique avec enthousiasme et prudence : enthousiastes quant aux possibilités, mais prudentes dans la mise en œuvre. Cela signifie fonder les décisions sur la stratégie (quel problème commercial résolvons-nous ?), investir dans les bases (données, systèmes, compétences) et placer l’éthique et la gouvernance au premier plan. Ceux qui se contentent de suivre le mouvement risquent de se retrouver parmi les 40 % de projets qui échouent, tandis que ceux qui planifient et pilotent avec soin sont susceptibles d’en tirer véritablement profit.

Les années à venir verront probablement l’IA agentique évoluer rapidement. Des normes telles que A2A et MCP pourraient arriver à maturité et réduire les difficultés d’intégration. Les modèles d’IA s’amélioreront, rendant les agents plus intelligents et plus fiables. La barre de la concurrence sera également placée plus haut : si votre concurrent dispose d’agents IA qui rationalisent ses opérations et que vous n’en avez pas, vous serez désavantagé. Cela rappelle les débuts de l’Internet ou de la téléphonie mobile : beaucoup de battage médiatique au début, quelques gagnants et perdants lors des premières tentatives, mais finalement, la technologie est devenue indispensable.

Pour l’instant, les chefs d’entreprise doivent se tenir informés, commencer à expérimenter et élaborer une vision de la manière dont les travailleurs humains et les agents IA peuvent travailler main dans la main. L’IA agentielle n’est pas seulement une tendance technologique à déléguer au service informatique, c’est un catalyseur de transformation commerciale qui nécessite la compréhension et le soutien des cadres supérieurs. Fortes de la tradition d’innovation et de précision de la Suisse, les entreprises suisses sont bien placées pour exploiter ces agents IA autonomes de manière pragmatique et efficace. En transformant l’engouement en impact concret (automatisation des tâches appropriées, gestion des risques), les organisations peuvent entrer dans une nouvelle ère d’efficacité et de créativité.

Comme on pourrait le dire : les agents sont prêts. La question est : le sommes-nous ?